Se você dá no campo da aprendizagem de máquina sugeriram, então seria: Nunca se esqueça a maldição da dimensionalidade. A explicação tradicional é a seguinte: "Se você tem um monte de dimensões de entrada, então o problema torna-se muito caro e difícil de resolver." É verdade, mas por que isso acontece? Vamos discutir isso com mais detalhes agora.

Uma dimensão do desastre a explicação mais intuitiva é olhar para o hiperesfera unidade e volume. O que isso significa? O ponto de dados principal é representada como d-dimensional vector. Assumimos que todos os problemas de pontos de dados específicos estão localizados na unidade hiperesfera. Nós todos sabemos que o 3D super volume esférico, é:

A dimensão d que é estendido, podemos ignorar o constante e o volume da mesma na equação c, variável, de volume e de forma a seguinte equação:

Observado seguinte um círculo, geometria, parece mais ponto cai (o espaço entre as linhas azuis e vermelhos) entre o reservatório. Em outras palavras, o círculo unitário escudo de raio 0,95 também é uma pequena fracção da área do círculo:

Um círculo unitário, o que gera os pontos de dados aleatórios

Agora, imagine quando olhamos para um hiperesfera d-dimensional, como sobre esta situação? A maioria das pessoas diria que é quase o caso, a maior parte do volume irá exceder shell hiperesfera. Mas a maioria das pessoas estão erradas. O fato é que os seres humanos realmente não posso pensar de espaço de alta dimensão. Não é intuitiva, não podemos imaginar. Vamos olhar o que realmente aconteceu. Podemos escrever a fração de volume ocupada pela caixa do hiperesfera d-dimensional, como segue:

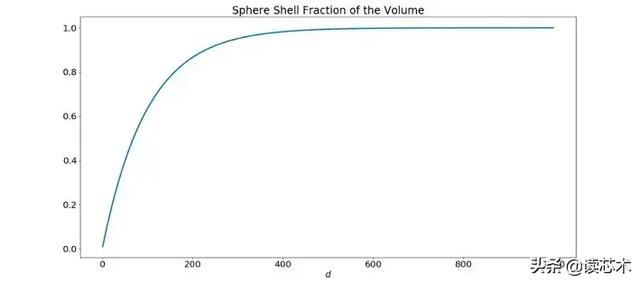

Se olharmos para os 5% tomar o caso de ultra-esfera de raio, o que muda haverá pontuação, a questão agora é muito claro. Com o aumento da entrada de dimensão d, o número residente no volume do alojamento é significativamente maior, como mostrado abaixo:

A figura mostra a fraco de volume hiperesfera habitação ocupada pelos dados como o número de dimensões aumenta.

Podemos ver que, a fracção de volume do crescimento exponencial da carcaça, é 1,1 dimensão em direção a seu limite. Mesmo que uma pequena quantidade de r, a fracção do invólucro 1 também é aumentado rapidamente.

O que isso significa, quando é que tal problema? A fim de observar essa mudança, vamos olhar para a distribuição de aprendizado de máquina mais comumente utilizado, ou seja, uma distribuição de Gauss. Se observarmos espaço de entrada uma densidade Gaussian tridimensional, é como um super-esfera, onde a probabilidade como o raio médio diminui, o que geralmente se aplica a mais de três dimensões, e você pode ver pela figura a seguir:

densidade Gaussiana bidimensional distribuição de Gauss. Pode ser o comportamento no espaço de dimensão superior esperado semelhante deverá nota como a densidade de objetos semelhantes a uma elipse.

No espaço dimensional elevada, o hiperesfera densidade Gaussiana focado na sua habitação, o que é devido ao volume de um hiperesfera faz parte do invólucro, que se torna significativa em um espaço de alta-dimensional. Isto significa que no caso de Gaussian amostragem, o resultado será uma concha super-esférica da maior probabilidade de pontos de dados.

Podemos pensar maldição da dimensionalidade da experiência da perspectiva de minimização do risco. Em suma, queremos obter uma amostra representativa de formação de nossos dados, a fim de ser capaz de ser estendido para dados não-visíveis. Agora, o exemplo hiperesfera, examinou-se a espessura da esfera quando o raio da esfera é de 5%, cerca de 400 dados de dimensão do escudo dimensional, esférica contendo mais do que 90% em volume. Imagine centro esfera (0% raio) e tem um raio de dados de amostra entre 95%. Neste caso, nós cobrimos 95% do raio, mas só cobre menos de 10% em volume. Obviamente, neste caso, é difícil obter uma amostra representativa.

Felizmente, a maldição da dimensionalidade não significa que não é possível estabelecer um modelo eficaz. Normalmente temos alguma suavidade garantia de dados, os dados não podem ser espaço tão densamente preenchido ou reduzir as dimensões (uma grande parte da pesquisa de aprendizagem de máquina). Talvez o melhor exemplo é o espaço de toda imagem RGB 64x64 possível. dados de dimensão de 64x64x3 = 12288. Se considerarmos o exemplo de um hiperesfera, que é obviamente um problema. Mas, na verdade, a maioria dos pixels de várias combinações não fazia sentido para qualquer tipo de classificação. Além disso, a abordagem de visão por computador tem um número de decisões anteriores úteis, o que torna o problema mais fácil de resolver.